提前曝光 Llama 3.1,Meta 为什么想做「大模子界

当地时间 7 月 23 日早上,Meta 开源了外界期待已久的大参数模子——Llama 3 405B。

Meta 发文称,该模子在多项基准测试中优于 GPT-4o 和 Anthropic 的 Claude 3.5 Sonnet。而且,扎克伯格预计,由 Llama3 支持的 Meta AI(Meta 的人工智能助手)使用量将在未来几个月内跨越 ChatGPT。

比肩天下上最壮大模子的 Llama3.1 开源,社交平台 X 上,许多人将这一事宜视为历史、拐点、史诗级时刻,这意味开源、闭源之间的差距进一步缩小甚至反超,还意味着开发者往后有了一个免费的最强基座模子在手。

在扎克伯格看来,这个拐点时刻则意味着「Llama 有时机成为开源 AI 的行业尺度」,就像 Linux 之于移动互联网一样。

但与之相反,不少从业者指出一个问题,4000 亿参数目级的麋集模子,即便开源,许多人可能也用不起来,尤其是思量到运行云云规模模子的算力集群的庞洪水平,再加上对照高的运行、推理成本,真正能用得上、用得转的开发者并不多。

去年 Llama2 开源时,外界原本期待 Meta 逐渐开源最强模子后,难望项背的 GPT-4 能力的可以瞬间免费地加持所有人,直接拿来探索 AI 应用。但现在似乎差异,从最强模子中蒸馏小模子,成为了 Llama 3 405B 新的产业意义吗?

01、Llama3.1:比肩 GPT-4o,非 MOE 架构,但多模态能力仍是期货

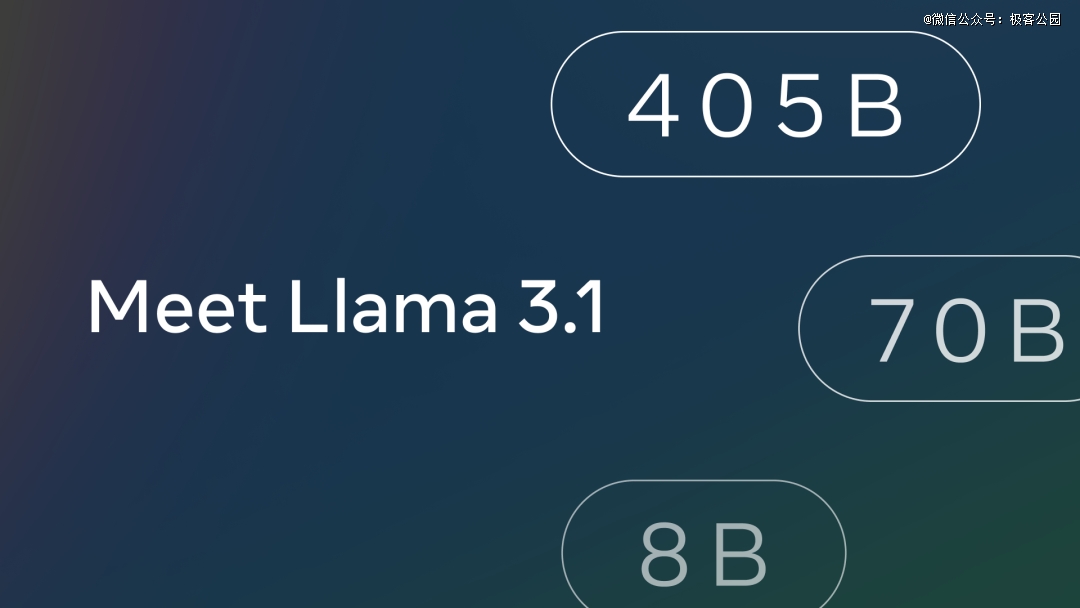

早在今年四月,Meta 先开源了 Llama3 系列的两个小参数版本的模子,8B 和 70B。比起几个月前的 Llama 3,现在推出的 Llama 3.1 升级了先前的 8B 和 70B 模子,还宣布了迄今为止*的开源模子 Llama 3 405B——后者拥有 4050 亿个模子参数,接纳了麋集 Transformer 架构,具有 128K 的上下文窗口。

相比 Meta 去年 7 月宣布的 Llama2,迄今为止*、*的开源模子 Llama3.1 在众多方面做了升级。

数据:使用了约 15T 的多语言 token,相较于 Llama 2 的 1.8T 有显著提升。

规模:Llama 3 的训练规模是 Llama 2 的 50 倍,模子参数和训练盘算量均大幅增添。

庞大性治理:选择尺度的麋集 Transformer 架构,而非夹杂专家模子,以确保训练的稳固性。

截图泉源:Meet Llama 3.1

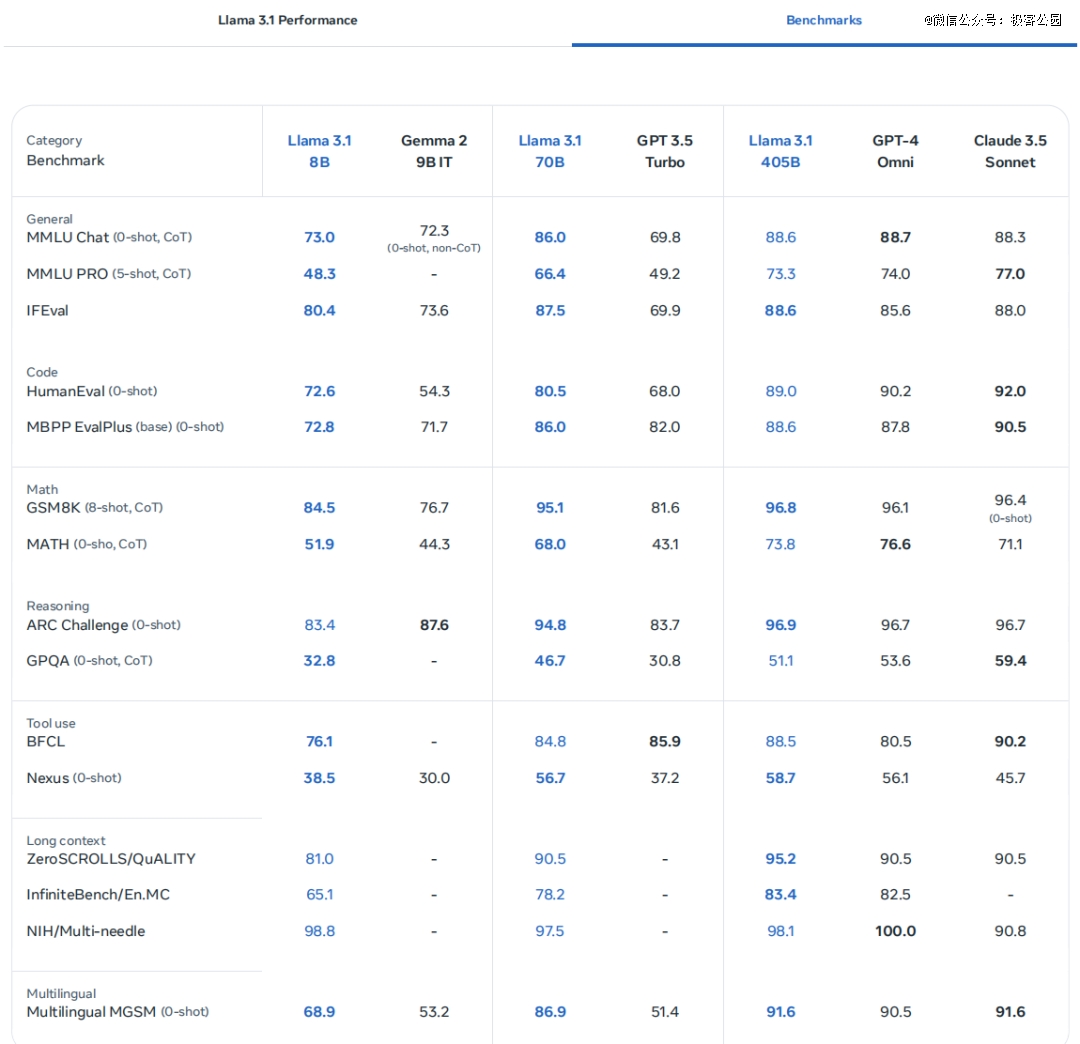

与行业水平相比,Llama 3 在多项义务上有着与*模子(如 GPT-4)相当的性能,其在多个基准测试中显示优异,包罗:

通用:在 MMLU、GSM8K 等基准上显示突出。

编程能力:在 HumanEval 和 MBPP 等编程基准上取得高分。

多语言能力:支持多种语言,尤其在德语、法语等语言上显示优越。

值得注重的是,去年 3 月 OpenAI 推出的 GPT-4 是拥有 1.8 万亿参数的 MOE 架构(夹杂专家模子),自那以来,海内外大模子厂商多数接纳或者迁徙至这一架构,但今天宣布的 Llama3.1 并没有接纳这一架构。

在现在火热的手艺蹊径——多模态融合上,Llama3 现在也并不支持。官方论文先容称,Llama 3.1 支持多语言、编程、推理和工具使用,但现在还无法处置图像、视频或语音。论文中提到,Meta 正在致力于为该模子添加图像识别、视频识别和语音明白功效,但具有这些功效的版本「仍在起劲开发中,尚未准备好宣布」。

02、Meta 的星辰大海是 AI 生态系统

今年 4 月的一档播客访谈节目中,扎克伯格透露今年年终才会推出 Llama 3 405B,而且这个模子开源与否要视情形而定。显然,这个时间表被提前了,在其尚不支持多模态、模子能力也尚不*时,现在就开源可获得。这是为什么?

在 Meta 官网,扎克伯格写了一封「开源 AI 是未来之路」(Open Source AI Is the Path Forward)的信,或允许以回覆这个问题。

在他看来,人工智能会以类似 Linux 的方式生长,而 Meta 有时机做大模子时代的 Linux,成为开源 AI 的行业尺度。

在高性能盘算早期,主要科技公司都投入巨资开发自己的 Unix 闭源版本,那时也很难想象任何其他方式来开发软件。但最终,开源 Linux 获得了普及——最初是由于它允许开发职员为所欲为地修改其代码,而且价钱更廉价,随着时间的推移,它变得更先进、更平安,而且拥有比任何封锁式 Unix 更普遍的生态系统,支持更多功效。现在,Linux 已成为云盘算和运行大多数移动装备的操作系统的行业尺度基础。

扎克伯格以为,只管多家公司正在开发*的闭源模子,但开源正在迅速缩小差距。以 Meta 为例,去年 Llama 2 只能与*梯队玩家的旧版模子相媲美,今年,Llama 3 与*进的模子竞争,并在某些方面处于*职位。Meta 预计,未来的几代 Llama 将成为业内*进的模子。

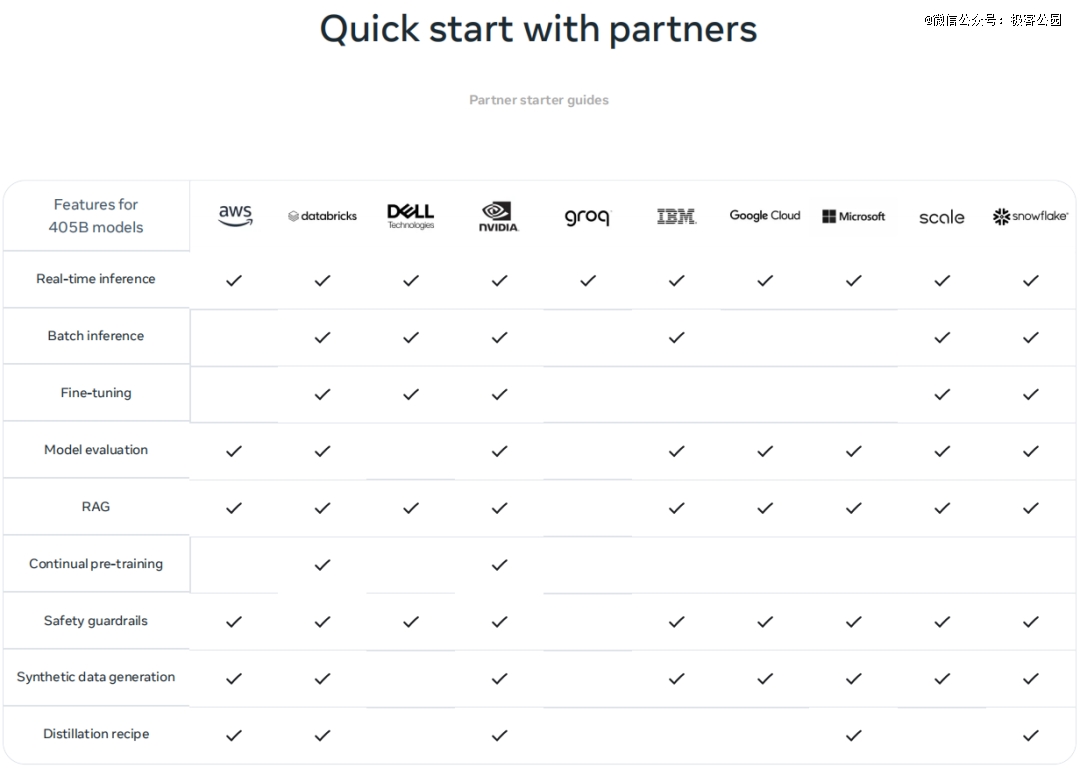

从这一代模子最先,Meta 还将通过确立普遍、开放的生态系统,致力于使开源 AI 成为行业尺度,使 Llama 成为行业尺度。好比像这次随同 Llama3.1 的宣布,与生态同伴的「嵌合」也加倍慎密:Amazon、Databricks 和英伟达推出全套服务来支持开发职员微协调「蒸馏」自己的模子。

像 Groq 这样的创新者已经为所有新模子构建了低延迟、低成本的推理。云厂商已经准备好云上部署 Llama3.1,包罗 AWS、Azure、Google、Oracle 等。Scale.AI、戴尔、德勤等公司已准备好辅助企业接纳 Llama 并使用自己的数据训练自界说模子。

截图泉源:Meet Llama 3.1

Meta 鼎力投资开源的基本缘故原由,固然是希望确保其可以获得*的模子。

但扎克伯格称,在 Llama-3.1 之前,他本能地以为,若是 Llama 开源,就会有一个社区自觉地围绕它发展。或许是思量到模子的部署差异于其他开源项目,还需要许多着手操作的环节、也需要许多资源支持,扎克伯格决议在扩展生态系统上更起劲。

「我信托 Llama 3.1 版本将成为行业的一个转折点,大多数开发职员最先主要使用开源,而且我预计这种方式只会从这里最先生长。」

OpenAI 的愿景是构建一个大 AI,Anthropic 和谷歌也有类似的愿景。但 Meta 的愿景是有许多差其余模子。每个创业公司、每个企业、每个政府都希望拥有自己的定制模子。而当闭源生态系统比开源系统好得多时,使用现成的闭源模子是更好的选择,但现在差异了。

现在,开源基本上弥合了这一差距,人们现在有动力去定制和构建并训练适合他们需求的模子,将他们的数据训练到模子中。

03、谁能用上 Llama 3.1?

1452个独角兽的隐秘-期货开户

官方讲述指出,Llama 3.1 使用了跨越 1.6 万个英伟达 H100 GPU 训练而来,The Verge 凭证其所用英伟达芯片的成本估量,其训练成本为数亿美元。

能省去这么一大笔钱,另有一个最强的基座模子,这是对开源最强模子的本能期待。但把模子落地加入景里,另有一个迫在眉睫的现实问题——到底有若干开发者有能力把 4050 亿参数的麋集模子用起来。

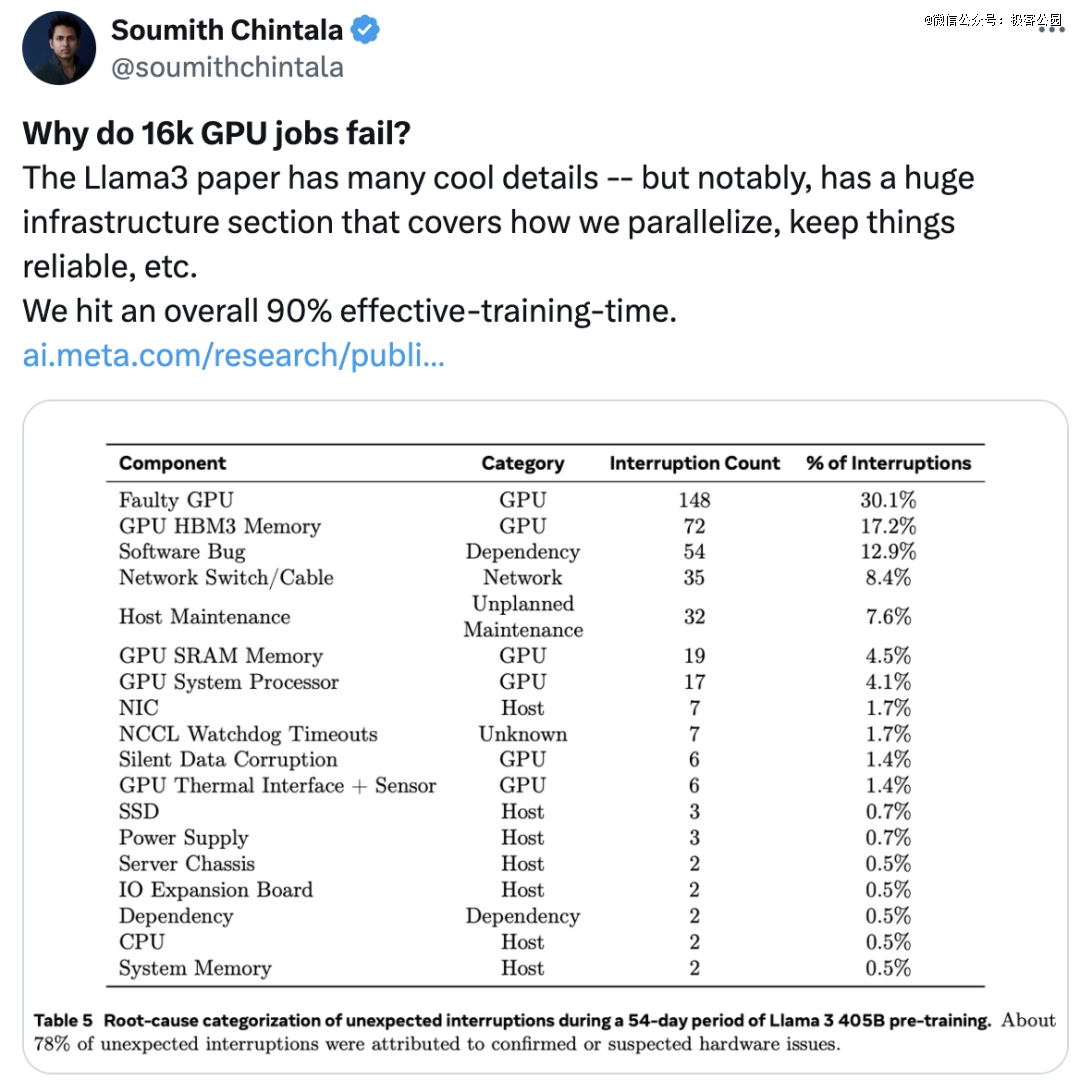

深度学习框架 PyTorch 的团结首创人、Facebook AI Research (FAIR) 的研究员 Soumith Chintala 发推称 Meta 调剂 1.6 万 H100 GPU 算力集群的有用训练时间到达 90%。|图片泉源:X.com

Llama3 论文中,有很长的篇幅在讲基础设施,1.6 万张 H100 集群在训练历程中会若何失败,包罗若何并行化、保持集群可靠等。对此,英伟达高级科学家 Jim Fan 转发点评,「基础设施事情是人工智能领域最被低估的事情,我能从这张表中的数字感受到内脏的疼痛和折磨」。

就运行 Llama 的开源模子而言,The Information 此前报道,应用程序开发者已经能够使用一组八个毗邻的 AI 服务器芯片(称为节点)来运行开源模子。Llama 3 的较小版本可以正常运行,但较大的模子可能无法顺应单个节点,而是需要多个节点。

辅助开发职员运行开源模子的推理提供商示意,这会带来许多庞大性。为大模子提供支持的节点必须能够协同事情,或者相互「攀谈」,而这并不容易设置。在某些情形下,这意味着节点在物理上必须相互靠近。

通常,对于较小的模子,推理提供商可以使用相同的节点来处置差异客户的请求,只要他们使用相同的 LLM。然而,对于较大的模子变得加倍难题,由于它们需要同时协调多个节点(多节点推理)。

有推理供应商称,可能需要几周甚至几个月的时间来重新设计他们的系统,以便能够处置来自 Meta 的 4050 亿个参数模子。在与日俱增的大模子领域,这是许多时间。

同时,这些多节点设置也会提高运行模子的成本,只管模子是免费提供的,但运行成本有时已经高于闭源模子。

Meta 固然意识到这个问题,与*开源模子一同推出的,另有生态同伴的互助方案,可以辅助任何开发者部署 Llama3.1 和种种工程化调优义务。但它仍然可能成为开发者使用 Llama3「超大杯」的一个挑战。

04、扎克伯格:乐于看到人们拿 Llama3.1 蒸馏小模子

在 Meta 看来,Llama 开源「除了相对于闭源模子具有显著更好的性价比之外,405B 模子的开放性这一事实将使其成为微协调蒸馏较小模子的*选择」。

此前,OpenAI 发现字节跳动通过大量与 GPT-4 对话、蒸馏其高质量数据后,*时间封号、阻止了这种做法。现在,Meta 却自动提出让人人蒸馏。更值得玩味的是,开源一个最强模子后的使用场景不是免费拿它去做 AI 应用,而是蒸馏自己的小模子。

ChatGPT 宣布一年半以来,真实的市场需求下,许多企业并不会大规模使用大模子 API,而是基于开源模子做微调、从最强模子中蒸馏出企业自己可用的小模子,由于用户和企业都异常体贴他们的私人数据,以及要害模子的「自主可控」。

其中,微调(Fine-tuning)指的是行使已有的预训练模子,在新的数据集上继续训练,对模子的参数举行少量的调整和优化,以使其顺应特定的义务或领域。

蒸馏(Distillation)则是一种将大型庞大模子的知识压缩并转达给较小、较简朴模子的手艺。能在保持一定性能的条件下,降低模子的盘算量和参数规模,提高模子的部署效率和运行速率。

扎克伯格接受 AI 博主采访时谈到对 Llama3「超大杯」的使用场景期待|截图泉源:X.com@rowancheung

扎克伯格在一档采访节目中重申了这一点,「我最感兴趣的是看到人们用它来蒸馏和微调自己的模子。我异常期待看到人们若何使用它,稀奇是现在我们制订了社区政策,允许人们将其用作西席模子来举行蒸馏和微调,基本上可以确立他们想要的任何其他模子」。

他以为,人们会希望直接在 4050 亿参数的模子上举行推理,由于据 Meta 估量,这样做的成本将比 GPT-4 低 50% 左右。人们可以将模子蒸馏到任何他们想要的巨细,用于合成数据天生,作为西席模子使用。

05、「Meta AI 将跨越 ChatGPT」

在大模子上,拥有最多 Super App 的 Meta,必须确保始终能够获得*的 AI 手艺。为了实现这一目的,开源是 Meta 的手段之一,战略则是确立一个壮大的、开放的 AI 生态系统。

但这也带来一个质疑,Meta 没有像亚马逊、谷歌和微软那样拥有能够行使大模子推动营业的云盘算,这就意味着 Meta 将其云云伟大的投入转化为收入的能力加倍有限。

扎克伯格反而将这一质疑视为优势,他称,「出售大模子的接见权限不是我们的商业模式。这意味着公然宣布 Llama 不会像闭源模子厂商那样削弱收入、可连续性或研究、投资能力。」

Meta 的 AI 商业化,现在仍是改善其广告营业、使其新的 AI 助手(Meta AI)成为杀手级 AI 用例。

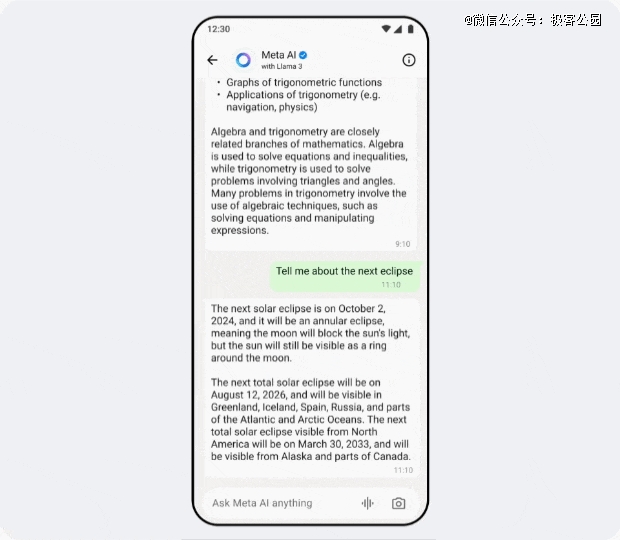

Llama 3.1 现在为 Meta AI 提供支持,Meta AI 是 Meta 应用程序和雷朋智能眼镜中提供的 AI 助手,它被定位为像 ChatGPT 这样的通用谈天机械人,险些可以在 Instagram、Facebook 和 WhatsApp 的任何地方找到。

可选 Llama 3.1 支持 Meta AI|图片泉源:Meta 官网

从本周最先,Llama 3.1 将首先通过美国的 WhatsApp 和 Meta AI 网站接见,随后在接下来的几周内通过 Instagram 和 Facebook 接见。它正在更新以支持新语言,包罗法语、德语、印地语、意大利语和西班牙语。

随同 Llama 3.1 的宣布,Meta AI 添加了一项新的「想象我」功效,可以凭证用户的特定肖像天生图像的功效。通过以这种方式而不是通过小我私人资料中的照片捕捉用户肖像,Meta 有望阻止确立深度伪造(Deepfake)机械。

Meta AI 也将在未来几周内泛起在 Quest 耳机中,取代其语音下令界面。就像它在 Meta Ray-Ban 眼镜中的实现一样,用户能够在 Quest 上使用 Meta AI 来识别和领会耳机直通模式下正在查看的内容,该模式通过显示屏显示现实天下。

扎克伯格在 Instagram 上发帖称,数亿人已经使用了 Meta AI。他展望,到今年年底,Meta AI 将跨越 ChatGPT(ChatGPT 拥有跨越 1 亿用户),成为使用最普遍被使用的 AI 助手。

对于未来的 AI 应用图景,扎克伯格称,Meta 的愿景是,应该有许多差其余 AI 及其 AI 服务,而不仅仅是单一的 AI,这一看法也影响了 Meta 的开源方式和产物蹊径图。

「我们的重点是让每个创作者和每个小企业都能确立自己的 AI Agent,使每小我私人都能在我们的平台上确立他们想要的 AI Agent,这些都是伟大的市场。天下上有数亿的小企业,一个企业可以通过几回点击就能确立一个 AI Agent 来举行客户支持、销售,并与所有客户相同。未来每个企业都市像现在有电子邮件地址、网站和社交媒体一样,拥有一个他们的客户可以交流的 AI Agent。我们将生涯在一个拥有数亿甚至数十亿差异 AI Agent 的天下里,可能最终 AI Agent 的数目会跨越天下上的人口,人们将以种种差其余方式与它们互动。这是产物愿景的一部门,其中有许多商业时机,这是我们希望赚钱的地方。」

最后,他还剧透,Llama-4 已经在路上了,甚至不止 Llama4。「设计盘算集群和数据轨迹不仅仅是针对 Llama-4,而是未来四五个版本的 Llama,这确实是件有趣的事情,由于这些都是需要耐久投资的事情,建设数据中央、配套的电力、芯片架构和网络架构等」。